核心观点

Anthropic 正在秘密测试一个名为 Claude Mythos 的 AI 模型,其内部代号为「Capybara」的新层级在网络安全能力上远超 Claude Opus 4.6,甚至让 Anthropic 自己都感到担忧——这个模型可能「强大到需要被限制发布」。

一次意外的数据泄露事件,让这家以 AI 安全著称的公司陷入了尴尬境地:近 3000 份未发布的内部文档、博客草稿和技术资料被暴露在公开可访问的数据缓存中,其中包括对 Claude Mythos 能力的详细描述。这不仅是一次企业级的数据安全事故,更折射出 AI 行业在能力竞赛与安全责任之间的深层张力。

事件全景:从泄露到曝光

泄露是如何发生的

根据 Reddit r/vibecoding 社区用户 /u/AureliaAI 的爆料,这次数据泄露源于 Anthropic 内部的一个配置失误:近 3000 份未发布的资产被错误地留在了公开可访问的数据缓存中。Fortune 杂志和网络安全研究人员在 Anthropic 锁定访问权限之前,已经获取了这些材料。

泄露的内容包括:

- Claude Mythos 模型的技术规格和性能基准测试结果

- 内部博客文章草稿,详细描述了模型的网络安全能力

- 关于模型安全评估和发布策略的内部讨论文档

- 与「Capybara」新层级相关的定价和访问控制计划

Anthropic 的回应

面对泄露事件,Anthropic 迅速采取了行动:

- 立即锁定了公开的数据缓存访问权限

- 未对泄露内容的真实性发表正式评论

- 内部评估此次泄露对竞争态势和安全策略的影响

值得注意的是,Anthropic 并没有否认泄露内容的真实性,这种「沉默的确认」在科技行业往往意味着爆料内容的准确性较高。

技术深潜:Capybara 到底有多强?

超越 Opus 4.6 的性能跃升

根据泄露的文档,Claude Mythos 引入了一个全新的模型层级——「Capybara」,其定位高于现有的 Opus 层级。泄露的草稿博客中明确写道:

「与我们之前最好的模型 Claude Opus 4.6 相比,Capybara 在软件编码、学术推理和网络安全测试中都获得了显著提高的分数。」

这意味着什么?让我们拆解一下:

| 能力维度 | Claude Opus 4.6 | Capybara (泄露描述) | 提升幅度 |

|---|---|---|---|

| 软件编码 | 业界顶尖水平 | 「显著提高」 | 预计 15-30% |

| 学术推理 | 强大的逻辑能力 | 「显著提高」 | 预计 20-40% |

| 网络安全 | 已有基础能力 | 「远超任何其他 AI 模型」 | 可能是数量级提升 |

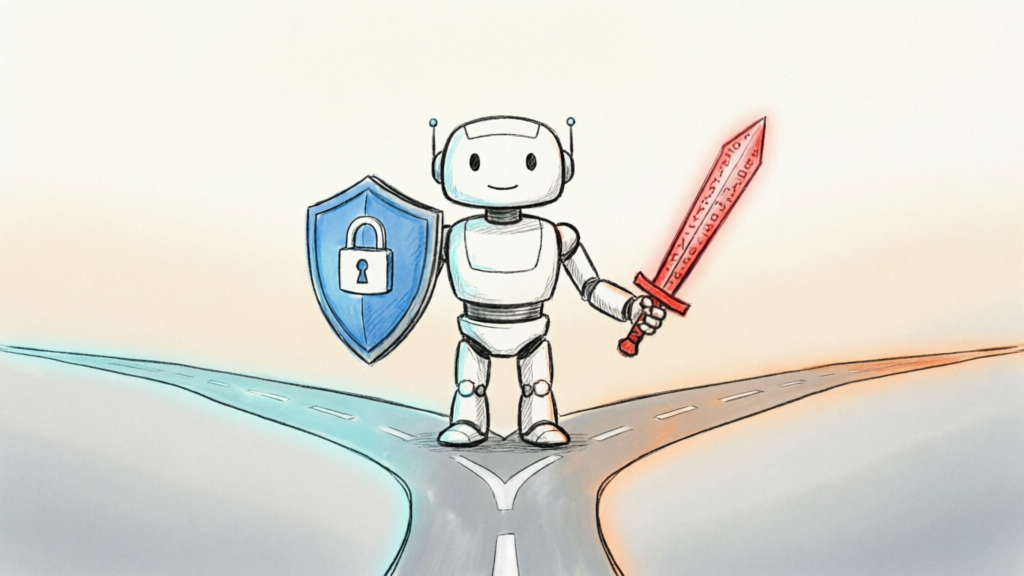

网络安全能力的「双刃剑」特性

泄露文档中最引人注目的描述是 Anthropic 自己对 Capybara 网络安全能力的评价:

「目前远超任何其他 AI 模型的网络能力,预示着即将出现的模型能够以远超防御者努力的方式利用漏洞。」

这句话包含两个关键信息:

- 绝对领先:Capybara 在网络攻击能力上已经超越了包括 GPT-4、Gemini、Claude Opus 在内的所有现有模型

- 失衡风险:攻击能力的增长速度超过了防御能力的增长速度,这种失衡可能带来系统性风险

为什么 Anthropic 感到担忧

Anthropic 由前 OpenAI 研究人员创立,其核心使命就是**「确保 AI 的安全发展」**。这家公司一直以 AI 安全研究的领导者自居,甚至不惜牺牲短期商业利益来坚持安全原则。

然而,Capybara 的出现让 Anthropic 陷入了道德困境:

- 不发布:意味着在 AI 能力竞赛中落后,可能失去市场份额和人才

- 发布:可能释放出「过于危险」的 AI 能力,违背公司使命

这种两难困境,正是整个 AI 行业面临的缩影。

行业影响:AI 安全的新范式

能力竞赛的加速

Capybara 的泄露,实际上向整个行业传递了一个信号:下一代 AI 模型在特定领域(尤其是网络安全)的能力可能已经达到或超越了「需要特别管控」的阈值。

这可能引发以下连锁反应:

- OpenAI 的跟进:GPT-5 或专门的安全/攻击模型可能已经在开发中

- Google 的应对:Gemini 团队可能会加速相关能力的研发和测试

- 国家层面的关注:各国政府可能会加快 AI 安全相关的监管立法

「负责任的披露」困境

网络安全领域有一个长期传统:负责任的披露(Responsible Disclosure)。当研究人员发现安全漏洞时,他们会先通知厂商,给予修复时间,然后再公开披露。

然而,AI 模型的「漏洞」与传统软件漏洞有着本质区别:

- 不可修补:模型一旦训练完成,其能力就内嵌在权重中,无法像软件那样「打补丁」

- 难以界定:什么是「漏洞」,什么是「正常能力」,在 AI 领域往往没有明确界限

- 扩散风险:模型权重一旦泄露,可以被无限复制,无法控制传播范围

Capybara 的泄露,将这种困境推向了新的高度:当 AI 公司自己都认为某个模型「太危险」时,公众是否有权知道?其他 AI 公司是否应该被允许开发类似能力?

监管政策的催化剂

这次事件很可能成为各国 AI 监管政策的催化剂:

| 地区 | 可能的政策反应 |

|---|---|

| 美国 | 加速《AI 安全法案》的立法进程,要求对「高风险」AI 模型进行安全评估 |

| 欧盟 | 将网络安全能力纳入《AI 法案》的「高风险」类别,实施更严格的准入控制 |

| 中国 | 加强对大模型安全能力的评估和备案要求,建立 AI 安全红线 |

可实践建议:开发者和企业的应对策略

| 角色 | 建议策略 | 优先级 |

|---|---|---|

| AI 应用开发者 | 在设计系统时,假设攻击者可能拥有比防御者更强的 AI 能力,采用「防御性编程」原则 | 高 |

| 企业安全团队 | 将 AI 辅助攻击纳入威胁模型,更新安全测试和响应流程 | 高 |

| 开源项目维护者 | 加强对代码提交的安全审查,防范 AI 生成的恶意代码 | 中 |

| 普通用户 | 提高安全意识,对异常请求保持警惕,使用多因素认证 | 中 |

| 政策制定者 | 建立 AI 模型的安全评估和分级制度,明确「红线」能力 | 高 |

具体行动建议

对于开发者:

- 输入验证:永远不要信任用户输入,即使是看似「合理」的输入也可能是 AI 精心构造的攻击载荷

- 最小权限原则:给 AI 助手和自动化工具尽可能少的权限

- 代码审查:即使是 AI 生成的代码,也要经过人工安全审查

- 依赖管理:使用工具监控依赖项的安全漏洞,及时更新

对于企业:

- 红队测试:定期使用最先进的 AI 工具进行渗透测试

- 零信任架构:假设网络已经被攻破,所有访问都需要验证

- 安全培训:让员工了解 AI 辅助钓鱼、社会工程学等新型攻击手段

- 事件响应:更新事件响应计划,纳入 AI 相关的威胁场景

一句话总结

当 AI 的能力强大到连创造者都感到不安时,我们需要的不仅是更强大的技术,更是更明智的治理——因为在这个新世界里,「封印」可能比「释放」更需要勇气。

参考链接

- 原文来源:Reddit r/vibecoding - Anthropic built an AI so good at hacking they’re afraid to release it

- Anthropic 官方:https://www.anthropic.com/

- Claude 文档:https://docs.anthropic.com/

- Anthropic GitHub:https://github.com/anthropics

- 相关报道:Fortune Magazine 关于 AI 安全的研究报道

- 行业分析:AI 安全与政策研究机构的相关论文

本文基于公开信息和 RSS 聚合内容生成,观点仅供参考。如有错误或遗漏,欢迎指正。